Was haben Diversität und Gender mit generativer Künstlicher Intelligenz zu tun? Eine ganze Menge, wie meine beiden Gesprächspartnerinnen heute zeigen. Denn Large Language Models (LLM) sind biased, also nicht neutral. Abhängig von Trainingsdaten und Gewichtung der verschiedenen Aspekte haben KI‑Modelle und die auf ihnen basierenden Systeme blinde Flecken und Datenlücken.

Diese Konstruktion verstärkt oft Vorurteile und Stereotype und kann damit, vor allem im Kontext der Sozialen Arbeit, ein echtes Problem sein. Sabine Klinger und Susann Sackl-Sharif forschen zu diesen Biases und legen den Fokus auf die mangelnde Diversität und die Gender Data Gap.

Gender Data Gap und Verstärkung von Ungleichheiten durch KI-Systeme

Der Gender Data Gap beschreibt eine traurige Tatsache: Die meisten Daten, sei es medizinisch, soziologisch oder in anderen Kontexten, werden zu Männern erfasst. Frauen wurden und werden deutlich weniger erfasst. Das führt dazu, dass wir bei Standardnutzern leider meist wirklich von der männlichen Form sprechen.

Bei KI-Systemen bedeutet das: Die Trainingsdaten haben viele blinde Flecken und Lücken in Bezug auf Frauen und ihre Rolle in der Gesellschaft und sie reproduzieren Stereotype und Klischees.

Im Podcast machen Sabine und Susanne deutlich, dass wir als Fachkräfte der Sozialen Arbeit durch unsere Prompts, also die Eingaben in KI-Systeme, zumindest eingeschränkt beeinflussen können, ob solche Klischees verstärkt werden.

Hier gilt: Weniger ist mehr.

Stereotype in KI-Systemen minimieren – durch cleveres Prompting

Ihr Hinweis: Wenn wir in Prompts genderbezogene Hinweise und Formulierungen weglassen, erhöhen wir die Chance, dass KI-Systeme neutraler antworten.

Wer beispielsweise einen Flyer für einen Mädchen-Nachmittag erstellen will, gibt damit den Impuls, eher weiblich geprägte oder das, was das KI-Modell auf Basis seiner Trainingsdaten so identifiziert, zu generieren.

Wird allerdings nach einem Flyer für einen Nachmittag mit Jugendlichen gefragt, tritt eine geschlechtsspezifische Prägung nicht oder deutlich weniger auf.

Mehr Tipps und praxisorientierte Hinweise findet ihr im Orientierungsleitfaden und im Interview. Viel Spaß beim Hören und Lesen und danke an Sabine und Susanne für eure Zeit und Arbeit.

Die wichtigsten Links im Überblick

- Link zum Orientierungsleitfaden: digitalesozialearbeit.github.io/orientierungsleitfaden

- Link zur Webseite mit Infos zu den bisherigen Projekten und entwickelten Materialien für die Praxis: digitalesozialearbeit.github.io

- Link zum aktuellen Forschungsprojekt von Sabine und Susanne: SocialAI: Chancengerechtigkeit und KI in der Sozialen Arbeit

- Link zur Website von Susanne Sackl-Sharif: www.sackl-sharif.net

Transkription des Podcasts mit Sabine und Susanne zum Orientierungsleitfaden „Diversitätssensibler Umgang mit künstlicher Intelligenz“

Intro: Sozialgespräch, der Podcast rund um Social Impact, digitalen Wandel und vor allem mit inspirierenden Menschen. Auf geht’s!

Christian Müller: Hallo und herzlich willkommen zu einem neuen Sozialgespräch-Podcast. Schön, dass ihr wieder reinhört. Heute habe ich zwei Gesprächspartnerinnen zu Gast. Eine davon könnten langjährige Hörerinnen und Hörer schon kennen. Die andere Kollegin, die heute dabei ist, ist neu. Ganz herzlich willkommen, Sabine und Susanne.

Sabine Klinger: Hallo.

Susanne Sackl-Sharif: Dankeschön.

Christian: Hallo ihr beiden. Schön, dass ihr da seid. Ich will gar nicht viele Worte zu euch verlieren, denn erstens stellt ihr euch gleich selber bitte nochmal vor. Und zweitens würde ich garantiert was vergessen bei den Sachen, die ihr macht, wenn ich versuchen würde, euch umfangreich vorzustellen.

Deswegen versuche ich das gar nicht erst. Ich würde, um die Reihenfolge einmal kurz zu erklären, Sabine bitten, den Anfang zu machen, und Susanne dann weiterzumachen mit der Vorstellung. Sabine, bitte.

Vorstellung

Sabine: Super. Vielen Dank. Auch danke für die Gelegenheit, dass ich nochmal dabei sein darf bei deinem spannenden Podcast. Mein Name ist Sabine Klinger. Ich bin Erziehungs- und Bildungswissenschaftlerin sowie Geschlechterforscherin.

Ich bin Assistenzprofessorin am Institut für Erziehungs- und Bildungswissenschaft an der Universität Graz zu den Themenschwerpunkten Bildung, Gender und gesellschaftliche Transformation.

Und ich beschäftige mich jetzt schon wirklich seit vielen Jahren mit dem Thema Digitalisierung, Gender, KI ist jetzt auch natürlich dazugekommen, in der Sozialen Arbeit in Bezug auf Bildungsprozessen und hier aber vor allem aus Sicht von Fachkräften und aus Sicht von Erwachsenen.

Das sind so Forscheungund Lehre zu den Themen, für die ich derzeit sehr stark brenne.

Susanne: Ja, und ich bin Susanne Sackl-Sharif. Ich bin Soziologin und Musikwissenschaftlerin und habe schon seit meiner Dissertation vor allem auch mit dem Thema Geschlechterforschung zu tun. Die Dissertation war noch über Geschlechterforschung und Heavy Metal.

Jetzt seit zehn Jahren beschäftige ich mich aber vor allem mit Digitalisierungsprozessen in der Gesellschaft und habe hier sozusagen auch Sabine kennengelernt. Wir forschen seit zehn Jahren zusammen zum Thema Digitalisierung in der Sozialen Arbeit, nun eben mit einem verstärkten Schwerpunkt auf künstliche Intelligenz.

Generative KI, Gender und feministische AI-Literacy

Christian: Dankeschön und willkommen. Liebe Hörerinnen und Hörer, ihr habt, glaube ich, verstanden, warum ich es nicht versucht habe mit der Vorstellung. Das wäre umfangreich geworden. Ich hätte garantiert was vergessen. Ich muss enttäuschen, wir haben es gerade schon gehört von Susanne. Es geht heute nicht um Heavy Metal. Schade eigentlich, aber das passt nicht ganz.

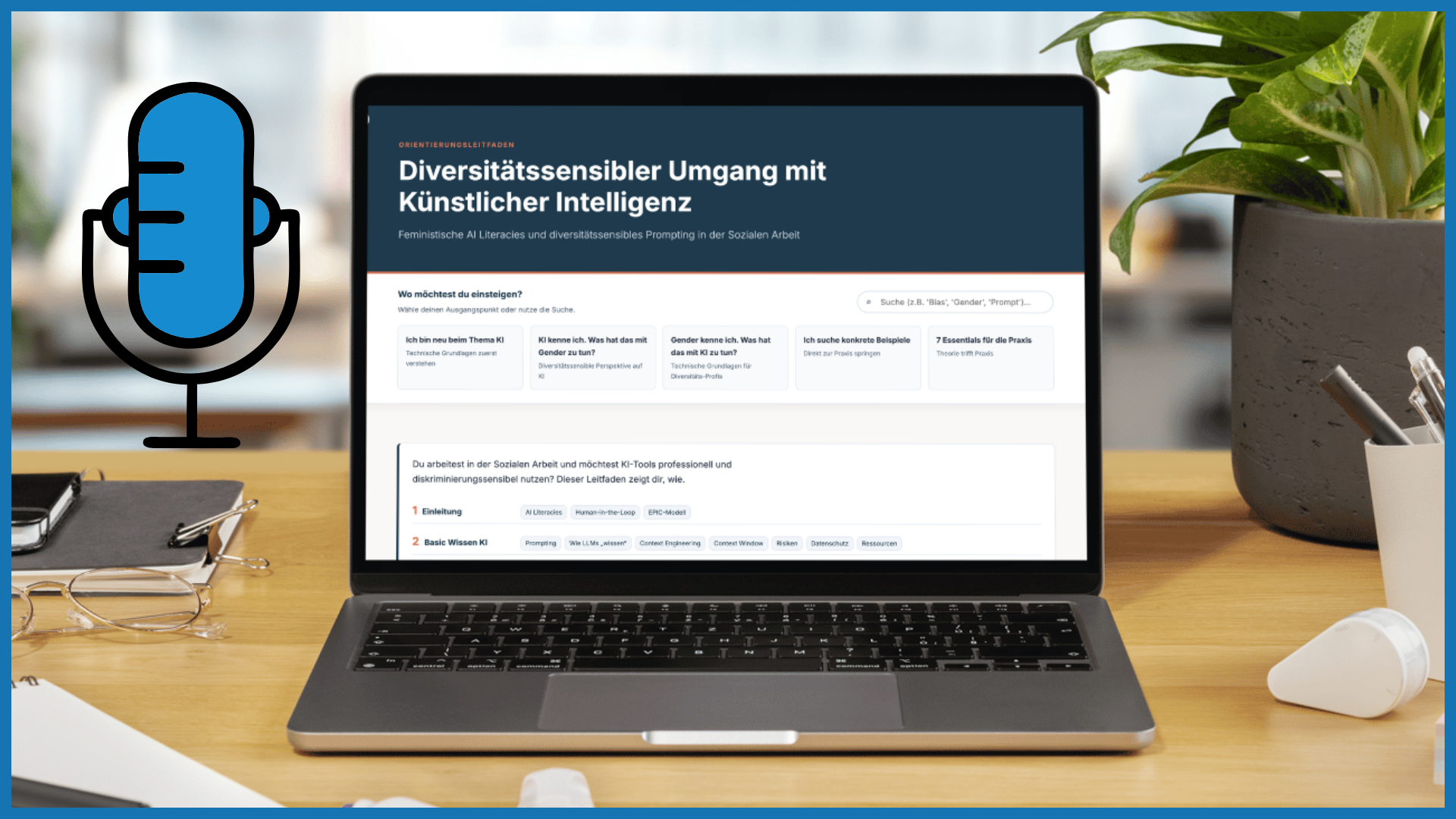

Unser Thema ist im KI-Bereich angesiedelt. Und zwar habt ihr einen Orientierungsleitfaden veröffentlicht. Das ist unser Thema heute. Der trägt eine Überschrift, die beim einen oder anderen vielleicht Fragezeichen auslösen könnte. Ich lese mal kurz vor. Der Titel des Ganzen lautet „Diversitätssensibler Umgang mit künstlicher Intelligenz“, Untertitel „Feministische AI Literacy und diversitätssensibles Prompting in der Sozialen Arbeit“. Gehostet ist das Ganze übrigens auf GitHub, was es auch noch ein bisschen ungewöhnlicher macht, vielleicht als manche anderen Leitfäden, die man so als PDF ins Netz stellen würde.

Lasst uns vorne anfangen mit KI und Co. Das kennen meine Hörerinnen und Hörer schon, dass ich die Überzeugung bin: Soziale Arbeit muss sich damit beschäftigen, vor allem mit generativer KI und mit dem Prompting. Das ist ja unser Fokus.

Aber was hat das denn bitte mit Gender und Diversität zu tun? Bias, ja, das kennen wir schon, das ist nicht das Thema, aber ihr habt da schon einen sehr klaren Fokus: feministische AI‑Literacy. Holt uns da mal ab: Wie kommt diese Themenverknüpfung zustande?

Sabine: Die liegt für uns auf der Hand, weil Soziale Arbeit ganz viel damit zu tun hat, sich mit sozialer Ungleichheit zu beschäftigen, sich mit Zielgruppen zu beschäftigen, die von sozialer Ungleichheit betroffen sind, mit vulnerablen Gruppen. Und da kommt das Thema Gender, Diversität, Ethnicity, intersektionales Arbeiten, alles dazu.

Und das alles trifft sich dann vor allem dann, wenn KI noch dazukommt, weil KI kann jetzt nicht mehr als wir können, sondern da wird ja auch nur Wissen abgegriffen, wenn wir von generativer KI sprechen. Trainingsdaten aus dem Netz, aus dem Internet, werden auch nur Daten abgegriffen und Trainingsdaten übernommen, die von Menschen hergestellt wurden.

Da sind schon ganz viele Bias und Vorurteile inhärent, diesen Daten. Und somit sind sie auch diesen generativen KIs wieder inhärent. Und wenn wir die in der Sozialen Arbeit nutzen, generative KI oder andere KI-Systeme, dann haben wir da auch nicht nur unseren eigenen Bias drinnen, den wir als Menschen mit uns mittragen und im besten Falle reflektiert, damit umgehen und auch damit quasi reflektiert und arbeiten, dass wir das nicht reproduzieren, die Biase und die Ungleichheiten, die wir so sehen, sondern wir haben auch nochmal die KI und die Outputs von den KIs, die auch wiederum diese Ungleichheitskategorien reproduzieren und in sich tragen.

Und damit ist es für uns eigentlich gar nicht so der große Sprung von der Sozialen Arbeit zu Gender, zu Diversität und zu KI. Und die Literacies kommen dazu, weil es ja auch um Fachkräfte geht. Da geht es also wirklich auch darum, wie können die das aneignen? Wie können Fachkräfte denn lernen, mit KI umzugehen?

Welches Wissen brauchen sie? Fachwissen, aber auch Wissen in Bezug auf Umgang mit KI, also Fähigkeiten und Fertigkeiten. Und das Feministische ist nochmal dazugekommen, um diese Herrschafts- und Machtverhältnisse nochmal dazu zu bringen, die ja auch in den Gender Studies und Geschlechterforschung auch nochmal ganz stark mit reinbringen.

Also die Frage nicht nur, was ist ungleich, also die Frage nach sozialer Ungleichheit, sondern auch, welche Macht- und Herrschaftsverhältnisse werden damit wieder reproduziert. Und da auch den Blick darauf zu richten und auch zu schauen und darauf hinzuweisen, dass das auch ein Aspekt in der Nutzung ist, den wir beachten sollten.

Und alles entstanden ist es, bevor Susi vielleicht noch auch ihre Sichtweise dazu gibt, in einem Projekt, das ich gerne nennen möchte, nämlich ein Elisabeth-List-Fellowship-Programm von der Universität Graz, wo wir mit vielen anderen Forschenden den aktuellen Stand des Leitfadens gemeinsam erarbeitet haben.

Christian: Wunderbar, danke schön. Susanne, hast du noch Ergänzungen zu dem Ganzen?

Susanne: Ja, also ich würde gerne ein bisschen rauszoomen und von einer anderen Seite das anschauen. Und zwar, wenn man es von der Geschlechterforschung auch anschaut, ist die KI eigentlich nur eine weitere Technologie. Und Technik wird aus der Geschlechterforschungsperspektive immer sozusagen im soziologischen oder im gesellschaftlichen Kontext verortet und kann nie neutral sein.

Aus dem Grund ist es vielleicht für uns, für Sabine und mich jetzt nicht so eine Kombination, die ungewöhnlich ist, sondern eher gewöhnlich, weil viele Aspekte, die wir allgemein bei Digitalisierung, aber genauso bei anderen technologischen Entwicklungen haben,

Das ist eben immer an soziale Ungleichheiten angebunden, weil sie von bestimmten Menschen mit bestimmten Vorurteilen entwickelt wird und von Menschen angewendet wird, die ebenfalls eben, wie Sabine schon gemeint hat, mit bestimmten Vorurteilen im Kopf zu tun haben. Und weder Mensch noch Technik sind jemals neutral und deswegen haben wir uns das zur Aufgabe gemacht, die Verknüpfung jetzt für die soziale Arbeit uns anzuschauen.

Christian: Wunderbar, danke schön. Also im Grunde ist es ja auch, ich sage jetzt mal, ein weiterer Aspekt der ganzen Bias- und Risikodiskussion im Thema generative KI. Ich sage in meinen Workshops ganz gerne, naja, die meisten Entwickler-Teams sehen halt so aus wie ich, weiß, männlich, privilegiert, da ist nicht so viel Diversität im Raum, wenn es gebaut wird, und das ist ein Problem.

Allerdings könnte man natürlich jetzt sagen, oder ich höre schon die ersten Kommentare die sagen: Na ja, Fachkräfte der Sozialen Arbeit sind ja ohnehin sensibilisiert. Und seien mal ehrlich, wenn so ein Ding nur männliche Namen oder keine Pronomen und Co. da rauswirft in einem generierten Text, dann werde ich das ja wohl noch gerade manuell angepasst bekommen, also platt formuliert.

Risiken unreflektierter KI-Nutzung und Biases in der Sozialen Arbeit

Die Frage einfach an euch: Was sind denn die ganz konkreten realen Risiken, wenn wir das eben nicht explizit adressieren und auf dem Schirm haben, nicht sensibilisiert sind dafür als Fachkräfte der Sozialen Arbeit?

Wenn wir generative KI verwenden und nicht auf dem Schirm haben, dass hier ein Bias zugunsten der männlichen Standardform oder das Ausklammern von bestimmten Erfahrungen von diversen Zielgruppen da eben stattfindet bei der Generierung? Welche Auswirkungen sehen wir da, wenn wir das nicht aktiv adressieren?

Sabine: Also zuerst möchte ich nur noch kurz etwas einführen, dass wir, wenn wir von der generativen KI jetzt sprechen oder auch in Bezug auf diesen Leitfaden, möchte ich einfach mal kurz nochmal betonen, dass wir jetzt von generativer KI sprechen. Das ist ja noch einmal was anderes als andere KI-Formen zum Beispiel.

Also wir sprechen von generativer KI, von Large Language Models, von Bildgenerierenden oder auch von Textgenerierenden Large Language Models. Und das ist immer also das eine, weil wir aus unserer Forschung wissen, dass KI oft auch in der Sozialen Arbeit als Sammelbegriff verwendet wird.

Und da fängt es dann schon an, wenn wir plötzlich etwas als KI adressieren, was vielleicht keine KI ist, sondern ein Entscheidungsunterstützungssystem, was jetzt auf andere Technik beruht und auf andere Entscheidungssysteme als generative KI.

Also mal so grundlegend, das ist mir mal wichtig als Erste sozusagen. Und ein Punkt von dir, Christian, war zu sagen, okay, wir Menschen haben ja alle, also die Fachkräfte sollten ja eigentlich alle geschlechter- und diversitätssensibel arbeiten.

Im besten Fall tun wir das, im schlimmsten Fall nicht, sage ich jetzt mal. Und wir versuchen plötzlich nur mal mit Menschen zu arbeiten, die ja dann ja auch plötzlich geschlechtsneutral sind.

Und eine bestimmte Adressierung von Geschlechtsneutralität kann ja auch wieder unbewusst eine Unconscious Bias herstellen, nämlich dass man dann unbewusst auch wieder Geschlechtsstereotype reproduziert.

Was bei KI vor allem wichtig ist, oder wenn man generative KI nutzt und da diese geschlechtssensible Brille weglässt, hat es einerseits Auswirkungen auf meine Prompts, also wie prompte ich, wie erzähle ich der KI, was ich gerade haben möchte.

Da geht es einerseits zu schauen, inwieweit macht es Sinn, zum Beispiel, wenn ich jetzt einen Nachmittag in einer WG-Gruppe plane, macht es da Sinn, die Geschlechtergruppe genau zu beschreiben, die ich da vor mir habe, sage ich, ich möchte einen Nachmittag für Mädchen gestalten oder einen für Burschen.

Macht das Sinn, da das reinzuschreiben?

Und dann ist natürlich auch der zweite wichtigste Punkt die Frage nach dem Human-in-the-Loop-Prinzip. Das machen wir auch wirklich ganz stark in diesem Leitfaden, dass immer wieder wir als Expertinnen, als Fachkräfte uns die Ergebnisse ganz genau anschauen, inwieweit reproduzieren die Inhalte, die wir da jetzt bekommen, wie der Geschlechterstereotype.

Wir haben ein paar Beispiele angeführt im Leitfaden, wie wir das gezeigt haben. Also Anwendungsbeispiele, da haben wir zum Beispiel einen Flyer erstellt für den Gaming-Nachmittag. Und da war das ganz, ganz, ganz spannend und wichtig für den Gaming-Nachmittag auch bestimmte Inhalte rauszubekommen, die dann wieder als kompetitiv gelesen werden, die dann wieder vielleicht eine bestimmte Geschlechtergruppe adressieren oder nicht.

Also das sind so mal für mich wichtige Aspekte. Und dann würde ich auch mal gerne hören, was denn Susi da meint.

Suanne: Ja, danke Sabine für das Zuspielen des Balls. Mir ist es noch wichtig, dass man sagt, eben einerseits die unterschiedlichen KI-Arten, was Sabine schon gesagt hat, das ist das eine.

Und wenn wir uns jetzt die generative KI anschauen, ist mir das noch ganz wichtig, dass die KI gibt dir tendenziell recht. Die ist gefällig. Sycophancy, wenn ich es richtig ausspreche, Sycophancy, ist hier sozusagen wichtig.

Das, was ich reingebe, vor allem jetzt im Deutschen und Englischen, das ist ja je nach Sprache ein bisschen unterschiedlich, gibt mir die KI, die generative KI, tendenziell recht. Das heißt, einerseits haben wir jetzt die Ungleichheiten in den Trainingsdaten. Generative KI hat ja mittlerweile Weltwissen, aber Wissen, das von Menschen erzeugt wurde, wo wir schon, auch vor allem, wenn man historisch das betrachtet, gewisse Lücken hat.

Zum Beispiel Gender Gaps. Es werden in unserer Geschichte nicht alle Menschen gleich repräsentiert. Und das heißt, diese Daten, auf die man zurückgreift, auch wenn es sich nach Weltwissen anhört, haben per se schon gewisse Lücken, gewisse Verzerrungen.

Dann ist die KI noch wohlwollend und gibt mir tendenziell recht. Und ich selbst bin in der Sozialisation in einer fairgeschlechtlichen Welt aufgewachsen. Das heißt, wir haben einfach sehr, sehr viel bei den Trainingsdaten, in den Modellen, die geben mir recht.

In meinen Prompts. Überall können sozusagen jetzt einfach Geschlechterungleichheiten oder Nicht-Diversitätssensibilität vorkommen. Und das alles kommt dann auch in die Outputs.

Das heißt, wir haben da sehr, sehr viele Stellen, wo es zu Verzerrungen kommen kann und zu Verzerrungen kommt. Und das wäre mein erst Impuls gewesen, Christian, nach deiner Frage.

Alle Menschen sind sexistisch und rassistisch. Das funktioniert gar nicht ohne. Auch ich bin es, weil ich in der österreichischen Gesellschaft aufgewachsen bin, am Land, mit gewissen rassistischen, sexistischen Vorteilen und ich muss auch immer wieder innehalten und kann versuchen, ein Unlearning zu machen.

Aber ich werde trotzdem auch immer sexistisch und rassistisch denken. Es wird nicht funktionieren, dass das komplett ausgeschalten wird.

Und daher ist es wichtig, mit diesem Wissen reinzugehen und sich alle Arten von Verzerrungen bewusst zu machen und das Bestmögliche durch Reflexion, durch Human in the Loop zu versuchen, um das zumindest ein Stück weit zurückzudrängen. Ganz wird es aus meiner Perspektive nie funktionieren.

Christian: Ja, das liegt nahe, vor allem ja auch deshalb, weil, wie ja schon gesagt, auch die generativen KI-Modelle ja von Menschen gefüttert wurden. Auch die Datenauswahl ist ja basierend auf dem, was Menschen geschrieben haben und was Menschen ausgewählt haben.

Plus, da kommt ja noch, das habt ihr auch schön geschrieben, mit Pre- und Post-Training bei euch jetzt auf dem Guide. Natürlich kommt auch dazu, dass technischer nochmal aus- oder feinjustiert wird, welche Antworten sind gefällig, in Anführungszeichen, bevor es veröffentlicht wird. Auch da spielen natürlich Bias es ja eine Rolle.

Also von daher ist es immer von Menschen gemacht und damit kann es gar nicht neutral sein. Allerdings würde ich gerne auf einen Punkt noch mal kurz eingehen. Wir kommen nachher sicher noch mal zu den konkreten Praxistipps für die einzelne Fachkraft.

Aber ihr macht etwas im Guide, was ich sehr schön finde, was ich auch regelmäßig in meiner Arbeit mache, was aber selten auf fruchtbarem Boden fällt. Und da differenziert ihr sehr schön die Tool-Level. Also sprich, ihr führt auch schön auf beim Punkt Basiswissen KI im Bereich Datenschutz ist es. Ja, was für bezahlte KI-Versionen, immer generative KI-Modelle ihr für welchen Einsatz grundsätzlich für sinnvoll haltet.

An der Stelle empfiehlt ihr sehr klar, dass wir natürlich über bezahlte Unternehmensversionen oder eigene reden sollten. Ich betone das „sollten“ an der Stelle. Wir wissen, glaube ich, alle, budgettechnisch passiert das leider nicht immer.

Gender Data Gap in LLM und generativer KI

Aber diese lange Vorrede dient einer konkreten Frage, die ich erst Richtung Susanne und dann Richtung Sabine stellen wollen würde, und zwar:

Gender Data Gap. Die LLMs an sich, also die Modelle, haben nun mal sehr unzureichende Daten, was am Datenset liegt. Wie realistisch oder wichtig würdet ihr es aus eurer Sicht sehen, dass Organisationen, wenn sie KI verwenden, ihre verwendeten KI-Systeme zusätzlich mit möglichst vollständigen Datensätzen, die eben auch nicht nur Gender, sondern generell diversitätsorientierte Datensätze integrieren?

Ist das etwas, ich habe es im Orientierungsleitfaden nicht gefunden, deswegen die Frage, ist das was, woran ihr arbeitet, was ihr schon versucht habt, was irgendwie auf der Agenda steht? Wie sieht es aus in dem Versuch, ich betone Versuch, diese Data Gap sowohl Richtung Gender als auch generell Diversität zu schließen?

Susanne: Genau, wir haben jetzt ein neues Projekt am Laufen. Also der Orientierungsleitfaden ist sozusagen die erste Version. Die baut auf unterschiedlichen Projekten auf, die wir schon durchgeführt haben.

Aber wir haben das, weil das Projekt sehr kurz war, noch nicht gemeinsam mit Fachkräften ausprobiert. Wir haben jetzt das Glück, ein neues Projekt zu haben, das drei Jahre lang laufen wird von der FFG in Österreich. Das ist ein Projekt, das sich dezidiert für Technik und Gender sozusagen die Ausschreibung war. Und hier werden wir jetzt gemeinsam mit Organisationen und Fachkräften der Sozialen Arbeit weiter an diesem Orientierungsleitfaden arbeiten.

Und eine der beteiligten Organisationen, Jugend am Werk, hat jetzt eine eigene generative KI, die genau sozusagen für ein eigenes System schon ausprobiert, wo eigene Daten, Formulare, ein eigenes Wissen noch zugeschaltet wurde.

Da ist es dann schon möglich, diesen Assoziationsraum, in dem generative KI arbeitet, ein bisschen zu beschränken oder zu beeinflussen. Wir selbst haben das jetzt noch nicht erforscht. Ich weiß nur, dass es das gibt und wir werden das jetzt uns anschauen.

Wir arbeiten auch eng zusammen mit dem Digital Humanities Craft.Das sind KI-Experten, die sich dezidiert mit der Technikperspektive beschäftigen, die auch schon bestätigt haben, dass es sehr gut ist, wenn Organisationen da noch eigenes Wissen hinzuschalten. Also, dass man Large Language Models durchaus noch zusätzlich füttert, weil man dann die Assoziationsräume, die Vorhersagen besser macht und besser für das Feld der sozialen Arbeit genau.

Sabine, hast du dazu noch was zu sagen, um den Ball mal zurückzuspielen?

Sabine: In dem Fall tatsächlich nicht, weil es ja auch das ist, wo wir in Zukunft nochmal drüber nachdenken werden. Und die Rückfrage ist einfach immer, die erste Sache, die mir einfällt, ist, für was soll die KI denn da sein? Wobei soll sie denn unterstützen?

Auch die Organisation. Also wenn das schon das Geld in die Hand genommen wird, um tatsächlich nochmal ein eigenes Tool zu entwickeln oder auf Basis von bereits bestehenden LLMs nochmal was aufzubauen oder auch ein Entscheidungssystem zu bauen für die Soziale Arbeit, dann ist zuerst einmal ganz wichtig zu klären, für was soll es denn da sein?

Geht es darum, einfach auf Wissen zuzugreifen in der Organisation und für Fachkräfte die Suche nach Inhalten einfacher zu gestalten? Geht es um die Dokumentation zu verbessern oder soll es das alles bedienen? Die Frage ist, gibt es denn tatsächlich bei der KI so one fits all?

Also mir fallen eigentlich neben dem, was Susi schon gesagt hat, noch viele Rückfragen ein, die man sich vorher wahnsinnig gut überlegen muss und durchdenken muss und es noch klare Entscheidungen gibt, am besten auch partizipativ in der Organisation, die sie gestalten muss, um dann auch das Geld gut zu investieren.

Das dann ja auch für die Organisation ja wieder sich bewähren soll.

Christian: Wunderbar, Dankeschön. Dann aber Richtung Sabine habe ich eine Anschlussfrage, die hat damit zu tun, geht ein bisschen mehr von der Technik aus. Was wir gerade besprochen haben, ihr habt ja auch in dem Guide, die drei Bias-Ebenen, sage ich jetzt mal, drin. Das hat ja viel mit den Trainingsdaten zu tun, also Model-Bias, sage ich jetzt mal, wo man versuchen kann nach zu trainieren, aber ehrlicherweise echtes Training wird wahrscheinlich nicht so schnell stattfinden, weil der Aufwand ist signifikant.

Und Output-Bias, also das Lesen des Ganzen, da habt ihr auch einen guten Output-Check drin. Das ist, glaube ich, das, was den meisten noch, aus meiner Sicht zumindest, relativ nahe liegt von den Fachkräften. Das sind die meisten oder viele, nicht die meisten, aber viele doch eh kritischer, wenn sie Output lesen von der KI. Glücklicherweise. Manchmal auch zu vertrauensselig. Andere Diskussion.

Input-Bias bei der KI-Nutzung in der Sozialen Arbeit

Was mich interessieren würde, Sabine, ist der Punkt Input-Bias. Also sprich, wenn ich als Fachkraft Dinge eingebe, was sind Faktoren, wo ich darauf achten kann, schon bei der Nutzung der KI?

Dass ich, wie ich das Ganze prompte, also bediene meine Anweisung, formuliere und Co., möglichst diversitätssensibel arbeite und typische Fehler vielleicht vermeiden kann? Gibt es da Dinge, wo ihr sagt, auf die drei Punkte oder wie viel auch immer sollte ich auf jeden Fall achten, das wäre wichtig in dem Augenblick?

Sabine: Also was mir grundsätzlich wichtig ist, das machen wir in dem Leitfaden auch ganz stark, ist das Bewusstsein, ein Prompt alleine ist keine Antwort. Also es wird auch von diesem iterativen Prompting oder man könnte auch wiederholtes Prompting sprechen.

Also das eine Anfrage hilft mir noch keine Antwort. Unsere Kollegen von den Digital Humanities Craft haben das mal sehr pointiert ausgedrückt. Die erste Antwort ist immer die schlechteste.

Das ist mal so der Punkt eins und das betrifft alle Inhalte. Das betrifft auch den Inhalt, wenn ich jetzt geschlechtssensibel oder diversitätssensibel prompte. Dann der zweite Punkt ist auch noch auf der allgemeinen Ebene zu sagen, die KI zu bitten, kritisch zu sein.

Kritisch zu überlegen, meine Frage kritisch zu beantworten, ehrlich zu antworten, nichts zu erfinden und auch Rückfragen stellen, wenn meine Anfrage unklar ist. So, jetzt sind wir noch ganz auf der allgemeinen Ebene, das wissen glaube ich viele.

Und dann kommt es noch dazu, wenn ich geschlechtssensibel arbeite, geht es wirklich vor allem darum, ich muss vorher mir selber gut überlegen, was ich denn will. Weil wir haben schon auch, wir haben diese Beispiele auch selbst ausprobiert und probieren auch ständig Beispiele eigentlich aus für die Praxis.

Wir haben ja auch im Leitfaden ein paar angeführt und was ganz deutlich ist, wenn wir zum Beispiel schreiben, wir möchten einen, ich habe es vorher schon genannt, dieses Beispiel, einen Nachmittag oder im Jugendzentrum, wir haben eine Mädchengruppe oder haben noch keine, möchten aber eine etablieren.

Das ist ein typisches Problem oft in Jugendzentren, dass das noch immer von Jungs und von Burschen auf den Anspruch genommen wird und weniger von Mädchen oder anderen Geschlechtergruppen. Wie kriege ich denn da die rein? Und das bedeutet, wenn ich da KI als Brainstorming oder als Ideengeberin nutzen möchte, dann muss ich das vorher alles gut beschreiben.

Und auch diese Mädchengruppe muss ich mir dann genau überlegen, wie genau beschreibe ich dich? Oft sagt man, je genauer das man beschreibt, ist es umso besser. Gleichzeitig haben wir aber, das ist unsere Praxis, gemerkt, je genauer das wir Geschlecht beschreiben, umso stärker bekommen wir die Reproduktion dieser.

Also wenn ich das schreibe, ja, sind Mädchen zwischen 12 und 14 Jahre, dann sind die Inhalte, die wir kriegen, viel Geschlecht der Stereotype, auch wenn wir sie bitten, die KI zu sagen, versuch es aber geschlechtsneutral zu formulieren.

Sondern da ist es oft, dass ich dann im Input, in meinem Prompt versuche, die Personengruppe genau zu beschreiben, aber Geschlecht lasse ich weg. Und das ist das Abstruse, also dieses Rausnehmen eigentlich in der Sprache, von was wir eigentlich sprechen, ist es immer so wichtig, Geschlecht zu adressieren und sichtbar zu machen.

Und in dem Fall aber vielleicht zu überlegen und auch auszuprobieren, macht es nicht mehr Sinn, wenn ich die Zielgruppe beschreibe, aber zum Beispiel ein Merkmal wie Geschlecht weglasse. Was ist denn dann der Input? Entschuldigung, der Output. Und ich kann ja dann einen Gegenversuch machen.

Und das ist so das Wichtigste. Also nur weil ich reinschreibe, bitte gib mir doch Inhalte, die geschlechtssensibel sind, bedeutet das nicht, dass sie geschlechtssensibel rauskommen. Und eine andere Hilfestellung ist es, in manchen Versionen kann man Kontextwissen zur Verfügung stellen.

Also zum Beispiel Texte, theoretische Texte zu geschlechts- oder diversitätssensiblen Arbeiten in der Sozialen Arbeit. Und dann kann man die KI auch bitten, auf das Konzept, das da dargestellt ist, zurückzugreifen. Da stelle ich noch Kontextwissen zur Verfügung oder einen speziellen Ansatz stelle ich zur Verfügung, auf die dann die KI zugreifen kann. Das muss ich aber explizit quasi hochladen.

Genau, das sind so die zwei wichtigsten Sachen. Und ich bin mir sicher, Susi, du hast nochmals zu ergänzen, weil wir denken oft gemeinsam.

Susanne: Ja, also was mir so wichtig ist, ich habe es schon kurz angesprochen, dass man wirklich diese Assoziationsräume im Kopf behält. Weil wie Sabine gesagt hat, das war für mich eigentlich, im Nachhinein ist es keine Überraschung, aber dass man es eben nicht explizit oft nennen sollte, weil sonst kommt der komplett stereotype Assoziationsraum, wird aufgemacht.

Und was durchaus auch gut funktioniert, dass sich die KI selbst noch einmal kritisch beurteilt. Also dass man sich wirklich dazu auffordert, analysiere jetzt deinen Output selbst noch einmal genau und zeige mir auf, wo es mögliche Bias, Verzerrungsstereotypienprobleme gibt.

Und wenn man hier noch genau anmerkt, in welchem Bereich man die KI hier nachlesen soll, dass man wirklich sagt, schau auf Geschlecht, gibt es da eine zu binäre Geschlechtervorstellung oder dass man auch sagt, Herkunft ist auch nochmal interessant oder dass man jetzt wirklich Rassismus und Sexismus prüfen lässt.

Das funktioniert dann nämlich gut, weil da kommt dann wirklich der Assoziationsraum, okay, Antidiskriminierung, es ist hier wichtig, gleichberechtigt einen Output zu erzeugen. Das funktioniert besser, als das dezidiert zu benennen.

Also geschlechtersensible Sprache ist hier fast schlecht im Large Language Model, was ich im Alltag bevorzugen würde. Geschlechtsneutralität ist oft tatsächlich besser und noch einmal die Bitte um Selbstkorrektur.

Christian: Wunderbar. Das heißt, das schreibt ihr ja auch im Guide. Man könnte ja meinen, viel hilft viel, aber im Grunde geht es ja eher um die Fokussierung, wenn wir tatsächlich sowohl Kontextdaten als auch Input darüber sprechen, weil KI ja dazu tendiert, wirklich alle Daten zu nutzen, die wir ihr geben.

Manchmal halt auch Dinge, die wir nicht unbedingt da drin haben wollten, um es freundlich zu sagen. Es denkt halt nicht. Darf man sich immer wieder mal, finde ich, ins Bewusstsein rufen, dass es eben kein Mitdenken hat an der Stelle.

Jetzt hört das hier vielleicht Fachkräfte und sagen: Okay, soweit klar, ich mache mir Gedanken über das Ganze, stellen sich aber vielleicht die Frage, für mich selber und meine Arbeit, soweit verständlich. Ihr habt ja im Guide auch noch drinstehen am Leitfaden, wie ich Zielgruppe einbinde, also partizipativ idealerweise in den Prozess integriere, der Erstellung. Soweit so klar.

Klient*innen bei der verantwortungsvollen KI-Nutzung unterstützen

Lass uns etwas die Perspektive wechseln, weil der zweite Teil der Arbeit für die meisten Fachkräfte, die zuhören zumindest, ist ja die Frage: Wie unterstütze ich denn, man könnte es auch Empowern nennen, wenn ich als Sozialpädagoge jetzt denke, meine Klient*innen dabei, verantwortungsvoll mit KI umzugehen?

Weil, was ich immer gerne bringe ist, also auch heute noch so, wenn ich zum Beispiel bildgebende Modelle, egal welche, bitte eine typisch deutsche oder österreichische Familie zu generieren, dann kommen da in der Regel Bilder raus, bei denen sich ein Großteil, zumindest der jugendlichen Klienten im Migrationshintergrund nicht wiedererkennen wird und wiederfinden wird, was ja doch ein paar Fragen aufwirft im Laufe der Zeit, wenn das die Normalität sein soll und ich da nicht dazugehöre.

So, jetzt haben wir aber noch den Punkt, dass zusätzlich, wenn ich jetzt nicht männlichen Geschlechts bin, ich potenziell ohnehin schon, wie ihr es auch schon dargelegt habt, im Output wenig bis gar nicht berücksichtigt bin, vielleicht sogar noch Stereotype verstärkt werden, die nicht unbedingt zu meinen Gunsten sind, nenn es mal sehr neutral. Und da stellt sich jetzt natürlich die Frage:

Okay, was kann ich als Fachkraft mit diesem Wissen tun, um meine Klienten, Klientinnen zu unterstützen? So, die Assoziationsräume für mich frei zu machen, kriege ich mit Reflexion, Arbeit und so weiter im Team sicherlich hin. Wie sieht das aus in der Klient*innenperspektive?

Also im Leitfaden habe ich so viel nicht gefunden, war auch nicht der Fokus, alles klar. Aber genau deswegen die Frage an dieser Stelle, was könnte ich als Fachkraft tun, wenn ich jetzt meine Klienten und Klientinnen habe, die ganz offensichtlich mehr generative KI verwenden, auch als Ansprechpartner?

Die Ebenen der Reflexion ist ein völlig anderes Thema. Können wir gerne in einer anderen Ausgabe diskutieren. Aber wie gehe ich damit um? Wie kann ich die unterstützen, bei sich dessen bewusst zu werden überhaupt, dass sie da schon fast systemisch diskriminiert werden?

Ich nenne es jetzt mal so, auch wenn es nicht ganz passt, weil es kein System ist, also ein technisches System ist. Und vor allem, wie unterstütze ich sie dabei, sich trotz alledem mit diesem Werkzeug, das für sie ja immer wichtiger wird, sinnvoll auseinanderzusetzen?

Susanne: Eine sehr schwierige Frage, weil wir uns damit tatsächlich noch nicht beschäftigt haben. Aber was ich bemerkt habe tatsächlich, Grundlagenwissen, was aus meiner Sicht in ganz kurzer Zeit vermittelt werden kann, wie generative KI funktioniert. Das hat bei mir selbst so viel gebracht. Da bin ich jetzt auch nicht schlauer gewesen als Jugendliche, bevor ich mich damit beschäftigt habe. Also niemand.

Also mir hat am meisten gebracht, um überhaupt einmal Large Language Models und wie diese funktionieren, ein Beispiel von unserem Kollegen Christian Steiner, der immer sagt, die KI funktioniert nicht wie ein Taschenrechner.

Viele haben sozusagen die Idee im Kopf, dass KI objektiv und neutral ist und dass man das sozusagen auch ganz dezidiert jungen Menschen noch einmal sagt. Nein, die wird nie neutral sein. Also vieles, was wir heute besprochen haben und die funktioniert auch nicht deterministisch, nicht wie ein Taschenrechner.

Jeder Output ist anders, je nachdem, was ich reinschreibe. Und selbst wenn ich dasselbe reinschreibe, kommt ein bisschen ein anderer Output dabei raus. Dass man wirklich das erklärt, je nachdem, dass die KI sehr sensibel ist für Begriffe und dass man hier wirklich einfach ein Verständnis schafft, dass man eben wirklich nur das nächste wahrscheinliche Wort vorhersagt.

Also wenn man das einmal versteht, dass man sagt, okay, selbst ein Tippfehler kann dazu führen, dass ganz ein anderer Output, ganz ein anderes Bild generiert wird. Das ist mir einmal wichtig, wirklich diese Technik ganz kurz und knapp, also bei uns hat das in einer Stunde gefruchtet, würde ich behaupten, dass man dann schon checkt, ja, aha, daher, da komme ich ganz woanders hin mit einem Wort.

Und dass man das dann ausprobiert, durch welche Begriffe kommt man in welche Assoziationsräume, dass man jetzt wirklich sagt, okay, wenn man jetzt den Begriff Engineer, das habe ich vor kurzem probiert, auf Englisch, wo ja nicht Female oder Male davor steht, im Deutschen haben wir ja so eine Ingenieurin oder Ingenieur, da sehe ich das Geschlecht, aber Engineer ist eigentlich neutral, aber es ist nicht in der KI neutral, es wird sofort eine männliche Person beschrieben.

Und wenn ich Female Engineer hinschreibe, dann werden ganz andere technische Kompetenzen beschrieben, die wieder verweiblicht sind. Also wirklich viel niedere technische Kompetenzen wird dieser Female Engineer zugeschrieben. Und dass man da einfach ein Bewusstsein schafft, wie funktioniert generative KI-Assoziationen, die sind sehr einfach geladen von unserer Gesellschaft.

Eben Beispiel Technik wird sehr männlich gelesen von der KI, ob ich es will oder nicht. Und dass man dafür mal sensibilisiert und dann gemeinsam ausprobiert, Beispiele ausprobiert. Da habe ich auch mit Studierenden die meisten Aha-Erlebnisse gehabt, wenn sie einfach so kleine Experimente durchführen und unterschiedliche Geschlechteridentitäten noch dazunehmen, unterschiedliche gesellschaftliche Bereiche prompten und so weiter.

Und ein Grundlagenverständnis wäre für mich, glaube ich, der Tipp der Stunde, dass man gemeinsam reflektieren lernt.

Christian: Dankeschön. Sabine, möchtest du noch etwas ergänzen an der Stelle?

Sabine: Nein, dem kann ich mir eigentlich nur anschließen. Also dieses gemeinsame Erproben von KI, das ist, glaube ich, eines der wichtigsten Sachen.

Und auch wenn die Modelle im Besserwerden-Geschlecht oder Ungleichheit weniger stark zu reproduzieren, ist das Beispiel, das Susi aus dem Alltag genannt hat, das lässt sich auch in der Studie nachweisen, wo einfach zum Beispiel die Begriffe She oder das Pronomen she wurde in 95 Prozent der Fällen einer Krankenschwester, also der Nurse, zugeordnet und he, einem Doktor, einem Arzt. Und das sind einfach dann auch die Feinheiten, die dann auch, und bei dem Bildgebenden ist es dann halt nochmal viel stärker.

Also weil es gleich das Visuelle anspricht. Und das gemeinsam auszuprobieren und auch zu gucken, wer wird denn repräsentiert, wenn wir einen bestimmten Prompt machen. Oder du hast vorher auch schon angesprochen, Christian, wir haben auch so Dinge drin, wie man partizipativ Inhalte zum Beispiel mit den Jugendlichen gestaltet kann.

Und das wäre für mich eine Gelegenheit, zu sagen, okay, wir wollen einen Nachmittag gemeinsam gestalten, machen wir einen Flyer mit einer bestimmten KI und dann das gleich zu nutzen und zu schauen, wer ist denn da jetzt oben?

Und welche Prompts braucht es dann überhaupt, um das sichtbar zu machen? Und da wird man dann schnell merken, dass es da sehr viele Prompts braucht, weil dann genau das passiert, was du schon gesagt hast, Christian, die KI denkt nicht mit. Die fängt immer wieder von neuem an.

Das heißt, wenn ich einen ersten Prompt habe und dann drei spätere und dann sage, verändere jetzt was, ist das immer am dritten Prompt. Und wenn ich aber am ersten Bild was verändern möchte, muss ich das nochmal sagen. Jetzt fangen wir da an.

Und das ist so eine Mischung aus Fähigkeiten und Fertigkeiten im Umgang mit der KI lernen und gleichzeitig dieses nochmal hinterfragen, wer wird denn repräsentiert? Was sehen wir denn da?

Und Algorithm Watch hat ja dann wirklich ganz spannende Studien auch durchgeführt mit auch Stelle uns den Politikerinnen da oder Manager, ManagerInnen mit bestimmten Nationen oder eine Ärztin, eine Ärztin aus Deutschland, eine Ärztin aus Ghana.

Also die haben das wirklich mit den Prompts schon sehr gut gezeigt und da hat sich meines Wissens jetzt nicht so viel geändert inwieweit das hier dann plötzlich auch Macht und Herrschaft wieder sichtbar wird. Plötzlich bleibt die Ärztin oder der Arzt weiß, aber die Patientin wird als Colored People dargestellt.

Also das ist wirklich nochmal sehr, sehr spannend, so etwas aufzugreifen und diese Reflexion ist ein Punkt, aber auch dieser Umgang mit dem Frust, weil ich glaube, da entsteht auch viel Frust, bei Jugendlichen zu merken, na super, jetzt bin ich da schon wieder nicht sichtbar oder mit dem, was mich interessiert oder was mich repräsentiert.

Also dieses wieder unsichtbar gemacht zu werden, in einen bestimmten Bereich oder in eine bestimmte Ecke geschoben zu werden, ich glaube, diesen Frust, mit dem umzugehen, glaube ich, der ist auch relativ wichtig.

Da habe ich aber leider kein Rezeptwissen. Hier würde ich dir jetzt gerne eines an die Hand geben.

Christian: Ich glaube ehrlicherweise, das erarbeiten wir alle gerade noch miteinander. Das ist ja viel mit Identitätsbildung zu tun. Da haben wir ja glücklicherweise schon ein paar Jahrzehnte Erfahrung insgesamt in der Arbeit. Die könnten und sollten wir, glaube ich, noch adaptieren.

Das wird halt noch spannend. Aber das sehen wir bei Social Media genauso. Ist ja jetzt nicht so riesen unterschiedlich, leider Gottes in der Repräsentanz.

Zwei Ergänzungen noch. Meine Dauer-Follower kennen das schon, meine Hörerinnen und Hörer. Ich ergänze aber auch nochmal in dem Blogartikel. Es gibt von der deutschen Sendung mit der Maus ein wunderbares Video, das sie die Funktionsweise von generativer KI erklärt. Ich nutze das sehr häufig, Das ist tatsächlich sehr süß gemacht und sehr aussagekräftig, wie ich finde. Das hat wirklich was.

Liebe Hörerinnen und Hörer, ihr seht es nicht, aber die beiden nicken zustimmend. Das ist ein wirklich schönes Video an der Stelle. Das macht unglaublich viel Sinn.

Ich schaue ein bisschen auf die Uhr, weil ich weiß, Susannes Raum ist noch bis 16 Uhr und wir nähern uns der Grenze. Das heißt, ich will es nie überziehen. Zwei Punkte habe ich aber noch, bevor meine Standardabschlussfrage kommt.

Punkt eins: Dieser ganze Leitfaden steht auf GitHub. Die Frage, warum ihr das genutzt habt, könnt ihr gerne am Rande beantworten, ist aber nur eine Nebenfrage. Die Hauptfrage ist tatsächlich:

Wunsch und Einladung zu Nutzung und Feedback des Guides

Habt ihr schon von Fachkräften und anderen, die es verwendet haben, Feedback bekommen in irgendeiner Form? Weil, liebe Hörerinnen und Hörer, ich verlinke das natürlich. Und so wie ich das Ganze verstehe, es ist eine große Einladung zu sagen, nutzt das Ganze. Ich habe mal einen Blick in das Zotero-Literaturverzeichnis geworfen. Ja, man hat ein bisschen was zu lesen, würde ich mal freundlich sagen. Ihr habt eine Menge Quellen am Start, die sich auch sehr, sehr lohnen.

Habt ihr da schon Feedback bekommen, was die Nutzung betrifft? Und ihr könnt auch raussuchen, welchen Aspekt ihr beantworten wollt, aufgeteilt. Was wäre denn euer Wunsch von der Nutzung her idealerweise, was mit dem Leitfaden jetzt passiert?

Susanne: Vielleicht kurz. Sabine und ich haben schon mehrere Produkte für die Praxis entwickelt. Da waren Videos, Flyer, PDF, Poster, was auch immer dabei. Bei diesem Thema haben wir uns jetzt dezidiert für eine Webseite entschieden.

GitHub aus dem einfachen Grund, weil wir hier schon eine Webseite hatten, um das auch upzudaten. Also wir sehen das jetzt als ersten Entwurf, den wir jetzt gemeinsam mit Fachkräften anpassen wollen und auch ein bisschen in den nächsten Jahren, solange das Folgeprojekt jetzt drei Jahre geht, auch aktualisieren wollen.

Weil natürlich KI schnelllebig, da wird es notwendig sein, einmal pro halben Jahr, einmal im Jahr hier auch das aktuell zu halten. Das ist der einfache Grund, warum wir es jetzt auf der Webseite haben.

Was haben wir uns für die Nutzung gedacht, wenn wir in den Leitfaden einsteigen? Für uns war es schwierig, deswegen ist es jetzt länger geworden, als wir das ursprünglich gedacht haben, auf welche Fachkraft wir treffen. Deshalb haben wir fast sowas wie in Personas, in typische Nutzer*innen gedacht.

Und da gibt es ganz am Anfang die Frage, wo möchtest du einsteigen? Und da gibt es unterschiedliche Möglichkeiten. Ich bin neu beim Thema KI und kann zunächst mich einmal mit diesen technischen Grundlagen beschäftigen. Es kann aber auch sein, dass ich KI wirklich schon sehr gut kenne, aber mit Gender noch wenig zu tun hatte. Dann kann ich bei diversitätssensiblen Perspektiven auf KI einsteigen und so weiter und so fort.

Vielleicht gibt es jemanden, der einfach nur konkrete Beispiele sich durchlesen will. Wie schaut es jetzt aus mit dem Prompting? Das heißt, wir haben jetzt für unterschiedliche NutzerInnen versucht, einen Einstieg zu ermöglichen, um direkt dorthin springen zu können, was ich jetzt direkt brauche.

Und die Rückmeldungen aus der Praxis, soweit wir sie jetzt haben, waren bisher positiv. Die waren jetzt aber noch nicht allzu viele, weil der erste seit Ende Februar online ist und wir jetzt erst starten nochmal damit, in die Praxis zu gehen.

Christian: Interpretiert das mal als Einladung, jetzt zu testen und euch Feedback zu geben. Die Kontaktdaten verlinke ich natürlich auch im Blog.

Sabine: Die Einladung kann ich nur unterstreichen, bitte gerne. Wir freuen uns über Rückmeldungen. Denn wie es genutzt werden kann, ist eher ein Baukastensystem tatsächlich. Und keine PDF, weil als PDF wäre das viel zu lange und auch viel zu überwältigend, glaube ich.

Weil es ist ein komplexes Thema und wir wollten aber die Komplexität auch nicht rausnehmen. Also simplifizieren, dass wir plötzlich auch noch mehr von DKI sprechen und eigentlich wissen wir. Aber das stimmt ja gar nicht. Das war wirklich ein ganz starker Balanceakt.

Deswegen haben wir es auch als Homepage oder als Webseite aufgebaut, wo man sich durchklicken kann. Von unten bis oben, von rechts nach links, wie man es gerne so haben möchte und braucht. Und so ist es auch geplant, den zu verwenden. Also man kann immer wieder rauf und runter hüpfen.

Ich würde es nicht empfehlen, das in einem Stück zu lesen, tatsächlich nicht. Sondern immer wieder mal reinzugucken und zum anderen ein bisschen nachlesen zu verwenden. dass man digital einen begleiten kann. Wir haben tatsächlich auch vor, dann zu überarbeiten. Und das wird auch Überarbeitung benötigen.

Also das ist zu schnelllebig das Thema. Und auch nochmal anzupassen. Und uns war tatsächlich auch wichtig, sowas wie, das haben wir heute gar nicht gesprochen, auch so KI in der Organisation, also so ein Gefühl für Organisationsebene reinzubringen.

Doch, das hatten wir ganz kurz am Anfang, die Frage. Oder auch diese, es gibt ja die Debatten Pro und Contra in der Einordnung von Debatten. Auch da haben wir gemerkt, oh, das ist aber so wichtig. Viele sagen auch, nee, ich verwende KI für Entscheidungen, aber das ist ja so neutral. Und das hat ja keine Emotionen und ich bin beim Fall, aber so emotional.

Und das nochmal wissenschaftlich zu kontextualisieren und einzuordnen. Also ein bisschen ein Nachschlagewerk könnte es vielleicht sein mit Anregungen, die dazu kommen. Und dann auch wieder, wo man vielleicht hoffentlich einige Aha-Erlebnisse auch kriegt mit den Seven Essentials mit, aha, okay, die erste Antwort ist ja gar nicht die beste, dann frage ich halt nochmal nach, dann mache ich es halt doch nochmal und frage nochmal kritisch nach und ach ja, das ist ja gefällig, das Teil, das will ja, das will mir ja gefallen, dann kann ich vor diesem Hintergrund zu arbeiten und immer wieder reinzugucken, ich glaube, das ist kein einmal, ich schaue einmal rein und bin fertig damit, Teil.

Christian: Nee, definitiv nicht. Und zum Stück lesen ist es auch definitiv zu lang. Wenn man sich vor allem noch das Thema gar nicht beschäftigt hat, dann wird man, glaube ich, noch einige Zeit investieren, was auch gut ist. Du hast aber schon einen Teil meiner Standardabschlussfrage vorweggenommen, Sabine. Deswegen fange ich jetzt mit Susanne an und bitte dich dann noch mal einen anderen Aspekt reinzunehmen. Denn meine Standardfrage, Sabine kennt das vom ersten Mal schon, ist immer:

Abschluss und Wünsche und Empfehlungen für die Guide-Nutzung

Worüber haben wir noch nicht gesprochen, was ihr unbedingt noch erwähnen wollt? Und Organisation war ja schon ein bisschen mit drin, haben wir vorher auch kurz angesprochen. Susanne, welche Aspekte hättest du gerne noch genannt gehabt, die wir vielleicht bei einer zweiten Folge, schauen wir mal, machen müssen? Aber was wäre dir noch wichtig als Thema, was heute zu kurz kam oder wir noch nicht besprochen haben?

Susanne: Tatsächlich nichts, um ganz ehrlich zu sein sind meine Punkte gut genannt.

Christian: Sabine, du hast welche benannt vorher schon, Organisationen zum Beispiel und Pro Contra, die sind ausführlich mit drin. Ich gucke auf die Uhr, ich weiß, Susanne muss gleich den Raum wechseln.

Dennoch, die Frage, gibt es noch irgendwas, wo du sagen würdest, wenn ich mir diesen Leitfaden angucke, was du als präferierten Start sehen würdest, eventuell, oder Einstieg in das Ganze dann auch?

Sabine: Wenn ich Nutzende wäre, ich würde gleich mal runter scrollen zu den Quick Guides, mir angucken, was ist denn Context Engineering und was hat das mit Prompten zu tun? Das ist so nochmal, aber das beschreibt genau das, was ich vorher mit diesen wiederholten Prompten und so gemeint habe.

Das ist, glaube ich, so, mit dem kann man gut einsteigen. Die Anwendungsbeispiele und diese, wir haben Seven Essentials genannt, so sieben Punkte, die man immer bedenken oder die man bedenken und mitnehmen sollte. Das ist so, glaube ich, ein cooler und guter Einstieg.

Wenn ich mich für Diskussionen warten möchte, die kritisch sind, dann würde ich wahrscheinlich wirklich zu den Pros und Cons gehen, zu fünftens.

Und was mir wichtig ist zu sagen, ist, dass der Leitfaden kein Plädoyer für Bitte nutzt alle KI. Sondern es bietet einen umfassenden, kritischen Einblick in das Thema, wie man es nutzen könnte. Und will keine Überzeugungsarbeit leisten.

Ganz im Gegenteil, jene Person muss sich selbst nochmal überlegen, für was brauche ich denn KI tatsächlich und für was will ich denn die KI und die Energie, die damit verbunden ist, in meiner Nutzung denn verwenden. Genau, diesen Aspekt der Nachhaltigkeit, den haben wir noch gar nicht besprochen, ist aber auch nochmal ein großes Thema.

Christian: Absolut. Das war fast schon ein schönes Schlusswort. Danke dafür. Wir machen es wie immer: Alle Links zu der ganzen Geschichte zum Leitfaden, zu all den Genannten, sei es das Fellowship-Programm, das es finanziert, sei es das nächste Projekt. Da habe ich gleich noch Fragen im Anschluss zu Links und Co.

Aber das findet ihr, liebe Hörerinnen und Hörer, natürlich, wenn ihr das hier hört, alles in den Shownotes und vor allem im Blogartikel begleitend zum Podcast. Da werden auch die Kontaktdaten meiner beiden Gesprächspartnerinnen drin sein, die sich sehr über Feedback freuen zum Orientierungsleitfaden, so wie ich das verstanden habe, vor allem, wenn ihr ihn verwendet.

Und was Sabine gerade gesagt hat, kommt in dem Orientierungsleitfaden, finde ich auch gut raus. Es ist kein „Nutz unbedingt KI“, es ist eher ein, „wenn du KI nutzt, dann doch bitte reflektiert und mit folgenden Fragen und Aspekten, die du berücksichtigen solltest, wenn du dich auf den Weg machst“. So habe ich das auch verstanden als Ansatzpunkt.

Ich danke euch beiden ganz, ganz herzlich für die Zeit. Da hat wieder viel, viel Spaß gemacht. Ich glaube, wir reden gleich noch ganz kurz über Potenzial. Nächste Folge sehen wir dann gleich mal.

Aber auf jeden Fall hatte ich Spaß. Liebe Zuhörerinnen und Zuhörer, ihr hoffentlich auch. Und euch beiden ganz herzlichen Dank für eure Zeit.

Susanne: Danke.

Sabine: Vielen Dank. Hoffentlich bis zum nächsten Mal. Tschau.

Outro: Sozialgespräch. Der Podcast rund um Social Impact, digitalen Wandel und vor allem mit inspirierenden Menschen. Auf geht’s! Bis zum nächsten Mal.

Schreibe einen Kommentar